Novedades

Cepal: La sustentabilidad como principio ausente en la IA de América Latina y el Caribe

América Latina y el Caribe enfrentan un escenario en el que la IA avanza en medio de fuertes desigualdades estructurales: por un lado, con una infraestructura crítica concentrada en pocos países y en expansión; y por otro, con debilidades en la incorporación de criterios de sustentabilidad, lo que plantea desafíos relevantes para el desarrollo futuro de la tecnología en la región.

Esto se puede concluir del “Índice Latinoamericano de Inteligencia Artificial (ILIA) 2025” hecho bajo el alero de la Comisión Económica para América Latina y el Caribe de las Nacoines Unidas (CEPAL) y que presenta una evaluación del estado de avance de la inteligencia artificial en 19 países de América Latina y el Caribe, con el objetivo de medir, comparar y orientar el desarrollo de sus ecosistemas. Para ello, construye un índice basado en tres dimensiones —factores habilitantes, investigación, desarrollo y adopción, y gobernanza— a partir de más de cien subindicadores, lo que permite identificar tanto avances como brechas estructurales en la región.

En este contexto, el informe muestra que la infraestructura digital —incluidos los centros de datos y la capacidad de cómputo— es un componente clave para el desarrollo de la IA, pero se encuentra altamente concentrada y distribuida de forma desigual: solo Brasil, Chile, Colombia y México cuentan con una industria de centros de datos considerada robusta. Por lo demás, es Brasil el que concentra más del 90% de la capacidad de cómputo de alto rendimiento. Aunque existen inversiones recientes que apuntan a expandir esta infraestructura, una parte importante de los países aún carece de capacidades suficientes para desarrollar y desplegar IA de manera autónoma. Por cierto, la falta de infraestructura propia (procesadores avanzados y centros de datos locales de alto rendimiento) obliga a los países a depender de servicios de nube extranjeros, lo cual representa un desafío para la soberanía tecnológica y la autonomía en el desarrollo de modelos de IA propios. Así, el documento afirma:

«Un mayor acceso a capacidad de cómputo de GPUs, servicios en la nube y consorcios tecnológicos regionales puede ser una estrategia eficaz para nivelar el terreno de juego para promover el desarrollo de soluciones de inteligencia artificial. La región necesita aumentar y consolidar sus capacidades de infraestructura de IA, con un mayor acceso a capacidad cómputo, de manera que mejore su resiliencia para el desarrollo y despliegue de la IA a través de un activo habilitante fundamental como la capacidad de GPUs».

CEPAL también enfatiza que, junto con esta expansión, emerge con fuerza el problema de la sustentabilidad y el impacto ambiental. En América Latina y el Caribe, el crecimiento de estos centros supone una amenaza debido a que muchas matrices eléctricas nacionales dependen todavía de combustibles fósiles, lo que aumenta las emisiones de gases de efecto invernadero. Un estudio citado en el informe (Uptime Institute, 2024) revela que solo el 35% de los centros de datos en la región operan con energía 100% renovable. Se destaca el caso de Uruguay como una excepción notable, con una matriz eléctrica 98% limpia. Por lo demás, se señala la falta de información sobre aspectos como el consumo energético y la huella de carbono de la IA, lo que dificulta evaluar su impacto real.

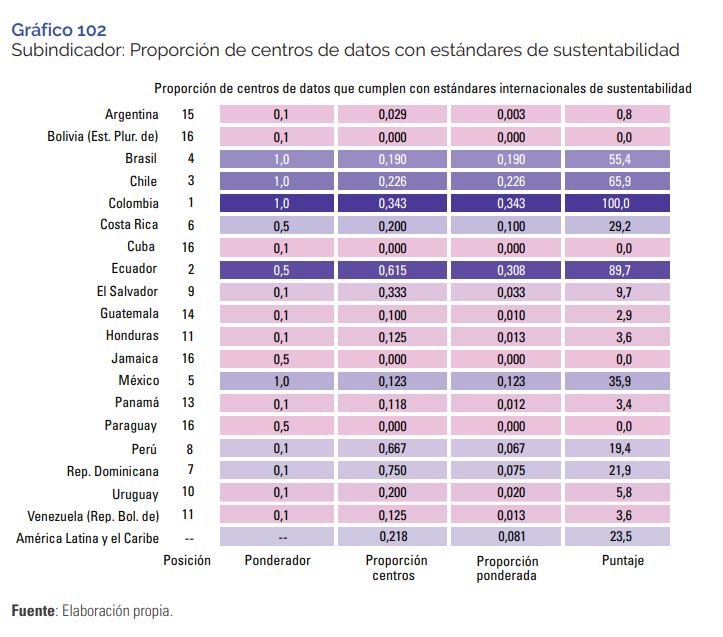

En el caso específico de los centros de datos de la región, el informe indica que solo un 20% (uno de cada cinco) cumple con estándares internacionales de sustentabilidad (con certificaciones como ISO 50001 de gestión de energía o LEED de diseño energético), evidenciando una brecha significativa entre crecimiento tecnológico y prácticas ambientales adecuadas. Interesante es constatar que Colombia es identificado como el país con la mayor proporción de centros de datos que cumplen con estándares internacionales de sustentabilidad en relación con la madurez de su industria, a diferencia de Chile donde la cifra es inferior al 25%. En este contexto, el informe identifica como desafío central la falta de datos públicos sobre certificaciones o eficiencia, lo que requiere colaboración regional para crear un repositorio de centros sostenibles.

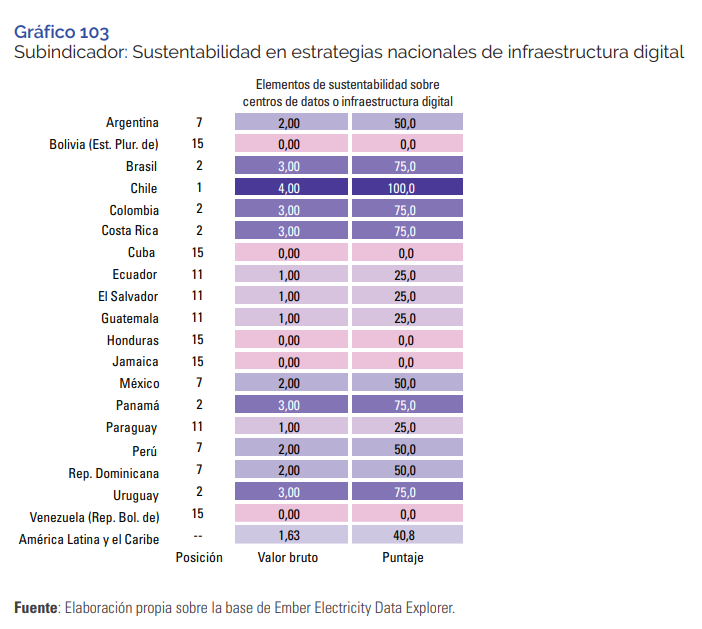

Asimismo, el texto destaca que la sustentabilidad no está integrada de manera relevante en las políticas de IA y transformación digital de la mayoría de los países (planes nacionales de transformación digital, agendas digitales, estrategias de inteligencia artificial, políticas de infraestructura de centros de datos, o marcos regulatorios específicos). Esto implica que el desarrollo de infraestructura y capacidades tecnológicas avanza sin una consideración sistemática de sus efectos ambientales, sociales y económicos. En este sentido, se advierte que, si no se incorporan estos elementos, el despliegue de la inteligencia artificial podría entrar en conflicto con los objetivos de desarrollo sostenible de la región. Es interesante que Chile tiene el máximo puntaje, debido a los criterios de sustentabilidad del Plan Nacional de Data Centers que ha sido criticado por las agrupaciones locales medioambientales, como constatamos aquí.

Finalmente, la CEPAL recomienda algo muy repetido: «el aprovechamiento de fuentes de energía renovables no convencionales puede ser un primer paso para utilizar las capacidades de los países para el despliegue de una IA limpia y ecológica». Demás está decir que en DataCenterBoom! no vemos a las renovables para nada como una solución milagrosa a la huella ecológica de la IA si no es combinada con una serie de otras medidas socioambientales y de principios de justicia energética y climática.